生成AIとディープフェイク技術の爆発的な進化とビジネス環境への浸透

人工知能技術、とりわけ深層学習(ディープラーニング)を基盤とする生成AIの進化は、ここ数年で非連続的な飛躍を遂げました。テキスト、画像、音声、動画など、あらゆるメディア形式において、AIは人間が作成したものと区別がつかないレベルの高品質なコンテンツを瞬時に生成する能力を獲得しています。この技術的ブレイクスルーの中心にあるのが、敵対的生成ネットワーク(GAN)や、ノイズの除去過程を利用して精細な画像を生成する拡散モデルといった革新的なアルゴリズムです。これらの技術は膨大なデータを学習し、データ内の規則性や特徴を抽出することで、全く新しい、しかし極めて現実世界のデータに忠実な出力を生み出します。

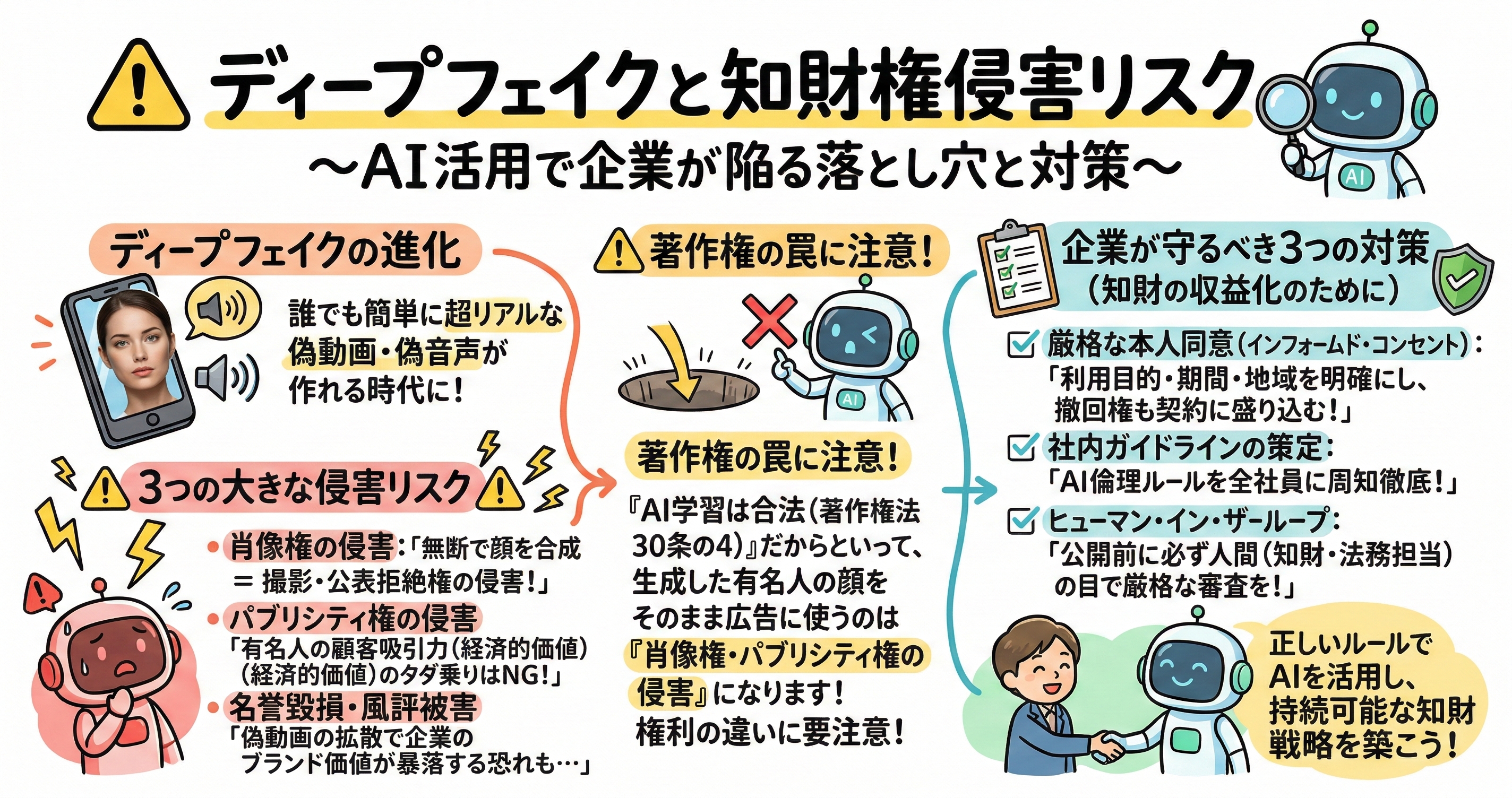

これらの技術を応用した「ディープフェイク」という概念は、もともとはインターネット上の特定のコミュニティにおける実験的な試みや、ハリウッドなどの大規模な映像制作における高度な特殊効果として発展してきました。しかし現在では、オープンソースモデルの公開や、直感的なインターフェースを持つクラウドサービスの普及により、高度な専門知識や高性能なコンピューターを持たない一般ユーザーであっても容易にアクセス可能なツールへと完全に民主化されています。今日では、ターゲットとなる人物のわずか数枚の写真や、数十秒程度の音声データさえあれば、実在の人物の表情や声色、口の動きを完全に再現し、その人物が実際には発していない言葉を語らせたり、行ったことのない行動をとらせたりする動画を、驚くべき短時間で生成することが可能です。

ビジネスの観点から見れば、この技術は映像制作のコストを劇的に削減し、多言語対応の吹き替えを本人の声質を保ったまま自動化し、さらにはバーチャルヒューマンを用いた24時間対応のカスタマーサポートを実現するなど、多大なメリットをもたらす可能性を秘めています。しかし、技術の民主化は同時に「悪用の容易化」も意味します。企業が十分な法的・倫理的検討を行わずにこれらの技術を実務に導入した場合、後述する肖像権やパブリシティ権の重大な侵害、あるいは第三者による企業ブランドへの攻撃に意図せず加担してしまうリスクが飛躍的に増大しているのが、現在のデジタルビジネス環境の偽らざる実態です。

肖像権の法的性質とAI生成物による無断利用がもたらす重大な人格権侵害リスク

日本法において、肖像権は明文の規定として法律に記されているわけではありませんが、日本国憲法第13条が保障する幸福追求権を根拠とする人格権の一環として、過去の多くの判例を通じて確立されている極めて重要な権利です。肖像権は大きく分けて、正当な理由なく自分の容姿を無断で撮影されないという「撮影拒絶権」と、撮影された写真や映像を無断で公表・利用されないという「公表拒絶権」の2つの側面を持っています。すべての個人は、自己の容姿や姿態に関する情報がどのように扱われるかをコントロールする権利を有しており、この権利を受忍限度を超えて侵害する行為は、民法上の不法行為を構成します。

ディープフェイク技術による生成物は、既存の写真や映像をAIの「学習データ」として取り込み、あるいは「素材」として直接的に加工することによって生み出されます。この過程において、本人の明示的な同意なくインターネット上などから顔画像が抽出され、合成される行為そのものが、肖像権の重大な侵害となる可能性を孕んでいます。さらにディープフェイクの事案で深刻なのは、それが単なる無断公開にとどまらず、「存在しない事実」を極めてリアルに捏造する点にあります。従来の無断撮影や盗撮が「実際に起きたプライベートな場面の不当な暴露」であったのに対し、ディープフェイクは「本人が絶対に行わないような行動や発言」を視覚的・聴覚的に捏造し、それをあたかも本人の姿であるかのように表現してしまいます。

企業活動において、例えばキャンペーン動画の制作にあたり、コスト削減のためにフリー素材の人物画像をAIで改変して自社製品を推奨するような動画を作成したとします。もしその元となった人物が特定可能であり、かつ改変や商業利用に対する事前の同意が得られていなければ、企業は肖像権侵害の責任を問われる可能性が高いです。また、AIが生成した「架空の人物」であっても、学習データの偏りやシステムの過学習によって、結果として実在の特定の人物に酷似した出力がなされてしまった場合、同様の法的リスクが顕在化します。このような偽造された映像によって被害者が受ける精神的苦痛は計り知れず、権利を侵害した企業は高額な損害賠償請求に直面するのみならず、深刻な社会的信用の失墜を免れることはできません。

パブリシティ権の保護対象と生成AIによる著名人の顧客吸引力の不当な経済的搾取

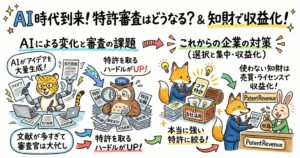

肖像権がすべての個人に等しく認められる「人格的な利益」や精神的な平穏を保護するものであるのに対し、パブリシティ権は、著名人の氏名や肖像などが持つ「顧客吸引力」という「財産的な価値」を独占的に支配する権利を指します。芸能人、プロスポーツ選手、著名なインフルエンサーなどは、長年の活動によって築き上げた知名度や好感度によって、商品やサービスの販売を強力に促進する経済的価値を有しています。第三者がこの顧客吸引力を無断で商業的に利用する行為は、パブリシティ権の侵害として、使用の差し止めや損害賠償の対象となります。

ディープフェイク技術と生成AIの急速な発展は、このパブリシティ権の領域にこれまでにない前例のない脅威をもたらしています。従来、著名人のパブリシティ権を無断利用しようとすれば、過去の映像や写真を切り貼りするなどの粗悪な手法に頼らざるを得ず、不自然さが残るため発覚も容易であり、効果も限定的でした。しかし現在の高度な音声クローン技術や顔合成技術を用いれば、ある著名人が自社の製品を絶賛している「完全な新規のCM映像」を、本人の一切の関与なしに作り出すことができてしまいます。

実際に海外の事例では、世界的に著名な俳優や歌手のAI生成音声・映像が、本人の許可なく投資詐欺の広告や無名ブランドのプロモーションに無断使用される事案が多発し、大きな社会問題となっています。もし日本の企業が、正規のライセンス契約を結ばずに「AIで生成した有名人に似たキャラクター」や「有名人の声を精密に模倣したAI音声」をマーケティング活動や製品プロモーションに利用した場合、パブリシティ権の直接的な侵害となることは避けられません。さらに、消費者を誤認させるような悪質なケースでは、不正競争防止法上の誤認惹起行為に該当する可能性もあります。著名人のアイデンティティは高度な知的財産の一部であり、それをAIというテクノロジーによって不正に搾取する行為は、クリエイターやタレントの正当な知財の収益化メカニズムを根底から破壊するものであり、企業コンプライアンス上、決して許容されるべきではありません。

悪意あるディープフェイクの拡散が引き起こす名誉毀損と企業の深刻な風評被害

ディープフェイクの悪用が引き起こす法的問題は、個人の肖像権やパブリシティ権の侵害に留まりません。生成されたコンテンツの内容や拡散のされ方によっては、刑法上の名誉毀損罪や信用毀損罪、および民法上の不法行為責任が問われる極めて危険な領域へと突入します。名誉毀損は、公然と事実を摘示し、人の社会的評価を不当に低下させる行為によって成立します。ディープフェイクを用いて、実在の人物が差別的な発言をしている動画、犯罪行為に手を染めている動画、あるいは本人の尊厳を著しく傷つけるような性的なコンテンツを生成して拡散する行為は、その人物の社会的生命を奪うに等しい凶悪な加害行為です。映像や音声が持つ「真実らしさ」はテキスト情報の比ではなく、一度拡散されたフェイク動画は、後からそれがAIによる偽造であると明確に証明されたとしても、視聴者の記憶に強烈なネガティブイメージを長期にわたって植え付けてしまいます。

企業が被害者となるケース、あるいは意図せず加害者となってしまうケースの双方において、事態のメカニズムは複雑化かつ深刻化しています。第一に、企業自身が「被害者となるケース」です。悪意のある第三者や競合他社が、企業の経営トップや広報担当者のディープフェイク動画を作成し、「自社製品に重大な欠陥がある」「大規模なリストラを計画している」「不正会計を行っている」といった虚偽の声明をSNS上で発表させたとします。現代のアルゴリズム駆動型の情報環境では、市場はこのショッキングなフェイク動画に即座に反応し、株価の暴落や製品の不買運動、取引先からの契約打ち切りといった甚大な経済的損失、すなわち大規模な風評被害が瞬く間に発生します。企業が公式な否定声明を出す頃には、既に莫大な損害が発生しているケースも少なくありません。

第二に、企業が「加害者となるケース」です。企業が広告代理店や外部の映像クリエイターにプロモーション用コンテンツの制作を委託した際、下請け業者が制作プロセスにおけるコスト削減や納期短縮のために無断で生成AIを使用し、インターネット上から無断取得した他人の顔を合成した動画を納品した場合です。これを企業が自社の公式プロモーションとして公開してしまえば、企業自身が肖像権侵害や名誉毀損の主体として、被害者からの法的追及や社会的な非難を浴びることになります。「下請け業者がAIで作ったとは知らなかった」という弁明は、サプライチェーン全体の責任を問われる現代の厳格なコンプライアンス基準においては全く通用せず、企業のブランド価値を回復不能なまでに毀損することになります。

マーケティング活動におけるAI活用と厳格な本人同意(インフォームド・コンセント)の必須性

このような多角的なリスクが存在する一方で、生成AIを適切かつ戦略的にマーケティング活動に活用することは、企業に強力な競争優位性をもたらすのも事実です。例えば、自社の専属モデルやアンバサダーのデータをAIに学習させ、本人が都度スタジオで長時間の撮影を行わなくても、季節やターゲット層、配信媒体に合わせた無数のパターンの広告ビジュアルを自動生成する仕組みを構築できれば、制作プロセスは劇的に効率化されます。

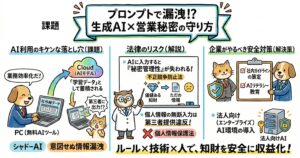

こうした正当な知財の収益化と業務効率化を両立させるための絶対的な前提条件となるのが、「対象となる人物からの明示的かつ具体的な同意(インフォームド・コンセント)」の取得です。ここで注意すべきは、AIの文脈における同意は、従来の「写真の利用許諾」と同じレベルのシンプルな契約で済ませてはならないという点です。生成AIによる利用は、本人の容姿や声がデータとして抽出され、将来にわたって契約締結時には「予期せぬ形」で出力される可能性を本質的に孕んでいるためです。

企業が実在の人物のデータをAIのモデル学習およびコンテンツ生成に利用する契約を締結する際は、複数の要素を極めて厳格に定義する必要があります。まず、生成されたコンテンツがどのような媒体で、どのような文脈で使用されるのかという利用目的と範囲を明確に限定することです。公序良俗に反する使用や、特定の政治的・宗教的メッセージを持たせる使用の禁止は当然のこととして明記する必要があります。次に、デジタルデータは容易に国境を越え、半永久的に保存されるリスクがあるため、利用可能な地域と期間を明確に区切ることが重要です。無期限の利用許諾や包括的な権利譲渡は、後々の重大なトラブルの火種となります。

さらに、AIが生成した最終的な出力物を、外部に公開する前に本人が確認し、自身のイメージやブランドにそぐわない場合は公開を拒否できる権利を保障するレビュープロセスの導入も強く推奨されます。そして最も重要なのが、同意の撤回権の明記です。一度AIの利用に同意した場合であっても、事後に本人が何らかの不利益を被る恐れが生じた場合や、所属事務所の移籍等があった場合には、対象となるデータの削除および生成物の使用停止、さらには学習済みモデルからの当該データの除外を求めることができる仕組みを契約に盛り込むべきです。包括的で曖昧な「AI学習への利用に同意する」といった一文のみで契約を済ませることは、企業側にとっても、後に本人から「そのような使われ方は想定していなかった」と訴訟を起こされるリスクを残すため、実務上極めて不適切です。

社内ガバナンスの構築とディープフェイク悪用を未然に防ぐコンプライアンス体制の確立

実在の人物の権利を保護し、企業自身のブランド価値を予測不能なAIリスクから守るためには、法務部門や知財部門が中心となって、AI利用に関する強固な社内ポリシーとガバナンス体制を組織全体に整備することが不可欠です。現場のマーケティング担当者やクリエイター個人のリテラシーや倫理観に依存する運用は、重大な事故の発生を待つようなものであり、組織としての統制が求められます。

まず第一歩として、企業は独自の「AI倫理ガイドライン」を制定し、AIを利用してはいけない領域を全従業員に対して明確に示す必要があります。いかなる理由や業務上の必要性があろうとも、他者の肖像権やパブリシティ権を侵害するディープフェイクの作成・利用、あるいは他者の尊厳を傷つけるコンテンツの生成は、重大な就業規則違反として懲戒処分の対象となる旨を周知徹底しなければなりません。

次に、具体的な業務プロセスの中に「ヒューマン・イン・ザ・ループ」と呼ばれる、人間の介在と承認フローを組み込むことが実務上強く求められます。AIを用いて生成されたコンテンツ、特に人間の顔や声を含むものを社外に公開する前には、必ず知財担当者やコンプライアンス担当者による厳格な審査プロセスを経ることをルール化します。審査においては、出力された人物が特定の誰かに似ていないか、学習に用いたデータの権利処理は適切に行われているか、利用したAIツールの利用規約に違反していないかといった項目を、専用のチェックシート等を用いて客観的かつ厳格に確認します。

さらに、業務を委託する外部ベンダーに対する管理体制も強化する必要があります。広告代理店や制作会社との契約においては、納品物の中に無断でAIによって生成された他者の肖像や著作物が含まれていないことを保証させる条項を設け、違反した場合には損害賠償を請求できる体制を整えるべきです。また、技術的な対策の導入も並行して進めることが重要です。企業が公式に生成AIによって作成したコンテンツに対しては、それがAI生成物であることを視覚的あるいは聴覚的に明示するとともに、コンテンツの来歴情報を暗号技術を用いてメタデータとして付与する仕組みの導入が、情報の透明性確保の観点から強く推奨されます。これにより、仮にコンテンツが独り歩きした場合でも、企業が責任を持って生成した公式な合成コンテンツであることと、悪意のある偽造ディープフェイクとを、社会やプラットフォーム側が技術的に区別できるようになります。

著作権法と人格権の複雑な交錯と知財リスク管理における認識の落とし穴

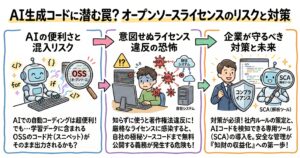

生成AIとディープフェイクを巡る法的課題は、肖像権やパブリシティ権といった「出力」に関する権利侵害だけにとどまりません。「入力」すなわちAIのモデルを学習させる段階における著作権法上の問題も、極めて複雑に交錯しています。

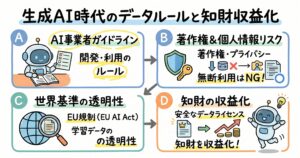

文化庁が開催した令和5年度の著作権セミナー等においても詳しく解説されている通り、AI開発における既存の著作物の利用と、生成物の著作権侵害に関する法解釈は、現在進行形で整理が進められています。日本の著作権法第30条の4は、情報解析を目的とする場合等において、原則として著作権者の許諾を得ることなく著作物をAIの学習用データとして利用できるという規定を設けています。これは世界的にもAI技術の研究開発に非常に有利な、イノベーションを促進するための規定として知られています。しかし、この規定の存在が、企業の実務現場において重大な認識の落とし穴を生み出しています。

その落とし穴とは、著作権法上の例外規定を、他のすべての法的権利に対する免罪符であると誤解してしまうことです。著作権法第30条の4は、あくまで「著作権」に関する権利制限規定であり、民法上の「肖像権」や「パブリシティ権」といった人格権・財産権の制限を免除するものでは一切ありません。企業が「日本の法律ではデータスクレイピングと学習は合法とされているから」と表面的な理解で、インターネット上から無断で大量の有名人の顔写真や音声データを収集し、自社専用のAIモデルを構築したとします。この場合、写真家の著作権侵害については一定の免責が働くかもしれませんが、そのモデルを利用して有名人の顔を生成し商業利用すれば、パブリシティ権の侵害として間違いなく法的責任を問われることになります。知的財産権としての著作権と、個人の尊厳や顧客吸引力を保護する肖像権・パブリシティ権は、保護する対象も根拠となる法律も全く異なる独立した権利であることを、企業の知財・法務担当者は深く理解し、現場に啓蒙していかなければなりません。

国際的な法規制の潮流と日本企業が目指すべき持続可能な知財戦略の未来

ディープフェイクと生成AIを取り巻く法規制は、現在世界中で急速に変化しており、グローバルにビジネスを展開する企業にとっては、国内法のみならず国際的な潮流を正確に把握することが不可欠です。欧州連合(EU)では、世界に先駆けて包括的な「AI法」が成立し、生成AIシステムに対する厳格な透明性義務や、ディープフェイクに対する明確な表示義務が法的に強制されるハードローの整備が進んでいます。米国においても、連邦レベルでの議論に加えて、各州レベルでディープフェイクを用いた選挙干渉や、同意のない合成メディアの作成を厳しく罰する法律が次々と制定されています。

日本国内においては、現時点ではガイドラインの策定等を中心としたソフトローによるアプローチが主流ですが、今後のディープフェイクによる被害状況の拡大や、国際的な規制調和の必要性に応じて、より厳格な法規制が導入される可能性は極めて高いと考えられます。企業は、現状の法解釈におけるグレーゾーンに甘んじることなく、常に一歩先を見据えた知財リスク管理体制を構築する必要があります。

他者の権利を深く尊重し、透明性の高い倫理的なAI活用を組織の文化として実践する企業こそが、消費者や投資家といったステークホルダーからの強固な信頼を獲得し、次世代のビジネス環境において持続的な成長と知財の収益化を実現することができます。ディープフェイクをはじめとする生成AI技術は、その扱い方を一つ間違えれば企業の存続を脅かす致命的な凶器となりますが、正しいコンプライアンスの枠組みと深い知財への理解の中で制御することで、かつてない創造性の扉を開き、ビジネスを飛躍させる強力なツールとなることは間違いありません。最新のテクノロジーと法の交差点において、正しい羅針盤を持ち続けることが、これからの企業経営には強く求められています。

1

文化庁 令和5年度 著作権セミナー「AIと著作権」文化庁 令和5年度 著作権セミナー「AIと著作権」 https://www.bunka.go.jp/seisaku/chosakuken/93903601.html

(この記事はAIを用いて作成しています。)