G7広島サミットが提起した生成AIの国際的課題とルール形成の行方

株式会社IPリッチのライセンス担当です。

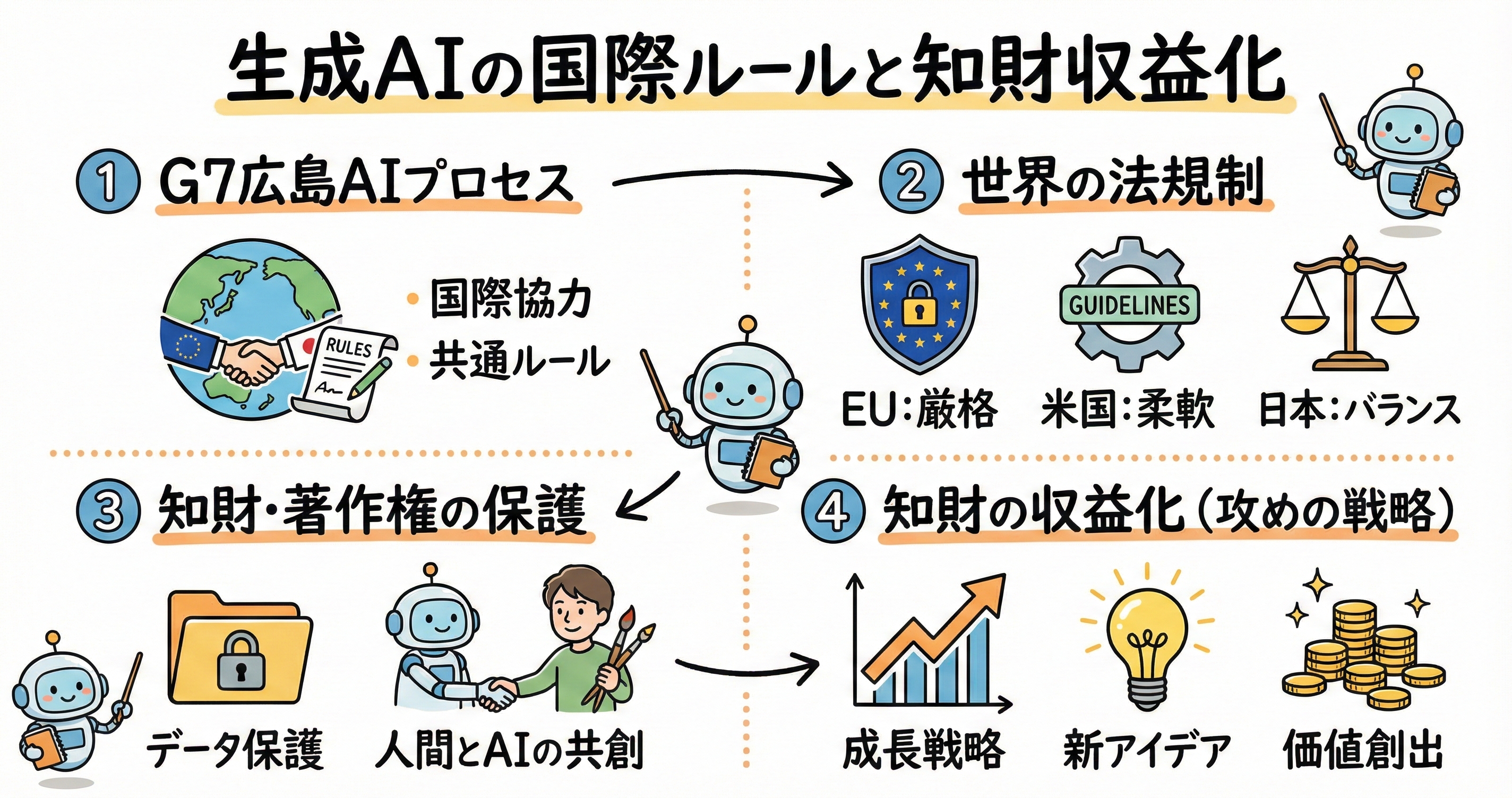

本日は、2023年のG7広島サミットを契機として国際社会で急速に議論が深まっている「生成AIの国際的課題と知的財産保護」について、世界各国の最新の動向や枠組みの整備状況を網羅的にお伝えする記事をお届けします。近年、生成AI技術が飛躍的な進化を遂げる中で、ビジネスの現場ではその革新的な機会を最大限に活かしつつ、著作権侵害やプライバシーの流出といった深刻なリスクをいかに管理するかが急務となっています。とくに、各国の法整備やガイドライン策定は目まぐるしいスピードで進行しており、国際的なルールや規制の方向性を正確に把握することが、グローバルに展開する企業の事業継続において不可欠です。本記事では、G7が主導する国際的枠組みから、EU、米国、日本の法規制の方向性、そして企業が留意すべき国際ルールの要点までを平易かつ詳細に解説してまいります。

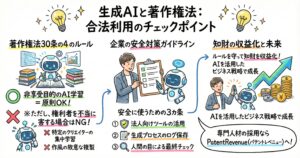

このように世界で生成AIに関するルール整備が進む中、企業にとっての次なる重要課題は、コンプライアンスを強固に担保しつつ、AI技術や膨大なデータを活用した「知財の収益化」をいかに実現するかという点にあります。AIモデルの学習データやアルゴリズム、そして生成されたコンテンツ自体が強力な知的財産となり得る現在、その権利を適切に保護し、ライセンス供与や戦略的提携を通じて事業の収益に直結させる高度な知財戦略が求められています。こうした戦略を推進するためには、最新の法規制と技術動向に精通した専門人材の存在が不可欠です。知財人材を採用したい事業者に向けて、知財特化型の求人プラットフォームである「PatentRevenue」で求人情報を無料で登録することを強く推奨いたします。自社の知財収益化戦略を一段と加速させるために、ぜひ以下のURLをご参照の上、ご活用ください。 https://patent-revenue.iprich.jp/recruite/

G7広島サミットと広島AIプロセス:生成AIの国際的課題と協調

2023年5月に開催されたG7広島サミットは、生成AIの急速な普及がもたらす光と影に国際社会が正面から向き合う歴史的な転換点となりました。このサミットにおいて、各国首脳は生成AIが経済成長やイノベーションを牽引する絶大な機会を提供する一方で、偽情報の拡散、プライバシーの侵害、そして知的財産の権利侵害といった深刻なリスクを孕んでいることを強く認識しました。この危機感と期待の双方が交錯する中で立ち上げられたのが「広島AIプロセス」です。これは、民主主義の価値観を共有するG7諸国が主導し、生成AIのガバナンスに関する国際的なルール形成を迅速に行うための枠組みとして機能しています。

同年秋から年末にかけて、広島AIプロセスは極めて具体的な成果を生み出しました。G7首脳は、高度なAIシステムを開発する組織に向けた包括的な政策枠組みに合意し、公式声明を発出しました。この枠組みは法的な拘束力を持たないソフトロー(非法的拘束力のある規範)の形をとっていますが、世界各国の国内法整備や企業行動の実質的な基準となる重要な意義を持っています。国際的なシンクタンクや学術機関の分析によれば、広島AIプロセスは「リスク管理とガバナンス」「ステークホルダーの関与」「倫理的および社会的考慮」の3つの要素を高度に統合した画期的なアプローチであると評価されています。

| 広島AIプロセスにおける包括的政策枠組みの4つの柱 | 内容の概要 |

| 優先的な課題・リスク・機会の分析 | 生成AIがもたらす経済的機会の最大化と、偽情報や権利侵害といったリスクの特定・評価 |

| すべてのAI関係者向けの国際指針 | 開発者から利用者まで、AIエコシステムに関わる全主体が遵守すべき行動原則 |

| AI開発者向けの国際行動規範 | 高度なAIシステムを開発する組織に対し、安全性テストや情報開示を求める厳格なルール |

| プロジェクトベースの国際協力 | 偽情報対策に資する研究の促進など、民主主義の基盤を守るための多国間での技術的連携 |

とくに知的財産とデータ保護の観点において、国際指針は極めて具体的な行動を企業に求めています。ガイドラインの第11項目では、組織が有害な偏見を軽減するためにデータの質を管理することに加え、個人データおよび知的財産を保護するための適切なデータインプット対策を実施することが推奨されています。ここでは、透明性の確保やプライバシーを保護する学習技術の導入とともに、システムが機密データを漏洩させないためのテストの重要性が説かれています。さらに、著作権で保護されたコンテンツを含む知的財産権を尊重するために、適切なセーフガードを導入することが明記されており、各国の適用される法的枠組みを厳格に遵守する義務が強調されています。

さらに、国際指針の第12項目は開発者だけでなく、AIを提供する者や利用するすべての関係者に対しても、高度なAIシステムの信頼でき責任ある利用を促進するよう求めています。これには、デジタル・リテラシーの向上や、偽情報の拡散といった特定の新たなリスクに関する情報を関係者間で共有し、脆弱性に協力して対処する体制の構築が含まれています。この包括的な枠組みは、その後の欧州、米国、そして日本における国内規制の方向性を決定づける羅針盤の役割を果たしており、企業はグローバル展開においてこの指針を基本方針として組み込む必要があります。

欧州連合(EU)のAI Act施行と著作権保護の義務化

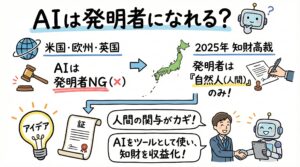

G7広島サミットで醸成された国際的なコンセンサスを、世界で最も早く包括的な「ハードロー(法的拘束力のある法律)」として結実させたのが欧州連合(EU)です。2024年7月12日、欧州連合官報にて正式に公布された「EU AI法(EU AI Act:Regulation 2024/1689)」は、世界初となる包括的な人工知能規制法であり、AIシステムが市民の基本的人権や健康、安全、そして知的財産権に与えるリスクを許容できないレベルから最小限のレベルまで分類し、それに応じた義務を課すリスクベースのアプローチを採用しています。

生成AIモデル、とくにEU法下で「汎用AI(GPAI:General-Purpose AI)モデル」と呼ばれる高度なシステムを提供する企業にとって、この法律は極めて厳格なコンプライアンス要件を突きつけています。EU AI法の第53条は、GPAIモデルのプロバイダーに対して、EUの著作権法を厳格に遵守するための明確な社内ポリシーを策定し、実行することを義務付けています。さらに、AIモデルの学習に使用されたコンテンツに関する詳細な要約を一般に公開することも求められており、これはAI開発における透明性をかつてない水準に引き上げるものです。無料かつオープンソースライセンスで提供されるモデルには一定の免除規定が設けられていますが、システム上の重大なリスクを引き起こす可能性があると判断された場合には、独自のパラメータやアーキテクチャ情報が公開されていても、同様の透明性義務が課されます。

知的財産権との関連において、最も実務的な焦点となっているのが「テキスト・アンド・データ・マイニング(TDM)の例外」と、それに対する権利者の「オプトアウト(利用拒否)」の権利の扱いです。EUのデジタル単一市場における著作権指令(DSM指令)の第4条3項では、原則としてデータ分析のための複製が認められていますが、著作権者が明示的に権利を留保(オプトアウト)した場合、AI開発者はそのデータを学習に使用することができません。ハンブルク地方裁判所における「LAION対Kneschke事件」や、ミュンヘン地方裁判所での「GEMA対OpenAI事件」など、DSM指令に基づくTDM例外の適用範囲を争う司法判断が続いており、権利者の保護と技術開発のバランスが司法の場でも厳しく問われています。重要なのは、EU AI法が、GPAIモデルが世界のどこで訓練されたかに関わらず、EU市場に当該システムを投入する以上は、このEUの著作権法およびオプトアウトの意思表示を遵守することを求めている点です。これは、AI開発企業にとってグローバルなデータ収集戦略の抜本的な見直しを迫る事実上の域外適用(ブリュッセル効果)を意味します。

法制化に伴う実務上の混乱を避けるため、欧州委員会のAIオフィスは、最終的な整合規格(標準ルール)が完成するまでの移行期間を埋める「行動規範(Code of Practice)」の策定を進めています。この行動規範の「透明性および著作権」に関する章は、AI開発者が第53条の義務をどのように満たすべきかの具体的な道しるべとなります。

| Code of Practice(行動規範)が求める主要な義務 | 企業に求められる具体的な対応と責任 |

| 文書化の徹底(Measure 1.1) | モデルのアーキテクチャや学習データに関する包括的な文書を作成し、変更の都度更新するとともに、市場導入後最低10年間にわたって記録を保管する義務 |

| 情報の共有と連携(Measure 1.2) | AIオフィスおよび下流のプロバイダーからの要求に応じて、最新の文書やコンプライアンス情報を遅滞なく提供するための連絡体制の構築 |

| 安全性とセキュリティの確保 | 最も高度でシステム上のリスクをもたらすGPAIモデルのプロバイダーに対し、最新のベストプラクティスに基づくリスク管理体制の構築を求める規定 |

欧州の動きは単なる域内規制にとどまらず、グローバルに事業を展開するすべてのテクノロジー企業にとっての事実上の世界標準となる可能性が高く、その動向には最大限の警戒と適応が求められます。

米国におけるAIガバナンス:NISTフレームワークと大統領令

EUが厳格な法規制によるアプローチをとる一方で、テクノロジー・イノベーションの震源地である米国は、政府の強力なリーダーシップのもとで、民間主導の技術標準とガイドラインの整備に重きを置く柔軟なアプローチを採用しています。この米国の方針を象徴し、世界的な影響力を持っているのが、米国国立標準技術研究所(NIST)が開発した「AIリスク管理フレームワーク(AI RMF 1.0)」です。2023年1月に公表されたこのフレームワークは、法的拘束力こそないものの、AIシステムを設計、開発、導入、利用するあらゆる組織が自主的にリスクを管理し、AIの信頼性を高めるための極めて実践的なガイドラインとして世界中の企業や政府機関から支持を集めています。さらに2024年7月には、生成AI特有のリスクに対応するための「生成AIプロファイル(NIST-AI-600-1)」も追加リリースされ、技術の進化に合わせた迅速なアップデートが行われています。

NISTのフレームワークは、AIが従来のソフトウェア開発とは根本的に異なる「社会技術的(socio-technical)」な性質を持っているという鋭い洞察に基づいています。AIモデルは学習するデータセットの偏りや時間経過に伴う変化、そして社会の動態や人間の行動様式といった複雑な要因の相互作用によって、予期せぬバイアスやリスクを生み出します。そのため従来のサイバーセキュリティ対策だけでは不十分であり、AI RMFでは組織の文化やガバナンス構造そのものを根本から変革することを促しています。米国内の法律や規制においても、このNISTのフレームワークを標準的なコンプライアンス要件として参照するケースが増加しており、事実上の業界標準としての地位を確立しつつあります。

| NIST AI RMFの4つのコア機能 | リスク管理における役割と具体的なアクション |

| Govern(統治) | 組織全体のリスク管理文化を醸成し、AIのライフサイクル全体にわたる透明性の高い意思決定プロセスと説明責任の構造を確立する |

| Map(把握) | AIシステムが利用される文脈を正確に理解し、技術的、社会的、法的なリスク(知的財産権の侵害リスクを含む)を網羅的に特定・分類する |

| Measure(測定) | 特定されたリスクの深刻度や発生確率を、定量的・定性的な指標を用いて継続的に評価し、システムの信頼性を検証する |

| Manage(管理) | 測定されたリスクを許容可能なレベルまで低減するための具体的な緩和策を実施し、インシデント発生時の対応プロトコルを運用する |

米国におけるAIガバナンスの機運をさらに加速させたのが、バイデン政権が発出したAIに関する大統領令です。この大統領令は、米国のAI分野におけるグローバルなリーダーシップを維持しつつ、安全性、セキュリティ、そして消費者のプライバシーや権利を保護するための多角的なアプローチを連邦政府機関に強力に指示しました。プライバシーの保護や公平性の推進、イノベーションと競争の促進といった項目が網羅されており、広島AIプロセスが目指す「民主的な価値観に基づく信頼できるAI」という理念と深く軌を一にしています。

これに呼応する形で、各産業分野に特化したリスク管理の枠組みも構築され始めています。例えば米国財務省は、金融セクターにおけるAI利用の安全性を確保するため、大統領令の行動計画に基づき「金融サービス向けAIリスク管理フレームワーク(FS AI RMF)」および共通の「AIレキシコン(用語集)」を発表しました。金融機関が融資の審査、顧客対応、不正検知などの意思決定においてAIへの依存度を高めるなか、組織間での不均一なリスク管理手法や用語の不一致がガバナンスの大きな障壁となっていました。これらの実践的なリソースの導入により、規制当局、技術提供者、そして金融機関の間で共通の言語が確立され、消費者保護と責任あるイノベーションの両立が図られています。米国市場で事業を展開する企業にとって、明確な連邦法による規制がなくとも、NISTのフレームワークに基づく堅牢なガバナンス体制を構築することは、法的リスクを回避し、ステークホルダーからの信頼を獲得するための絶対条件となっています。

日本におけるAI事業者ガイドラインと知財保護のアプローチ

G7の議長国として広島AIプロセスを力強く牽引した日本も、国内におけるAIの健全な社会実装に向けて、独自の枠組みによる環境整備を迅速に進めています。日本のアプローチは、EUのようなイノベーションの阻害要因となり得る過度な事前規制を避けつつ、産学官のマルチステークホルダーの参加による「アジャイル(機動的)なガバナンス」を推進するという、ソフトロー中心の柔軟な政策方針が特徴です。その集大成とも言えるのが、2024年4月に総務省と経済産業省が共同で策定・公表した「AI事業者ガイドライン(第1.0版)」です。

このガイドラインは、急速に変化するAI技術に対応するため、これまでに総務省や経済産業省が個別に策定してきた「AI開発ガイドライン(2017年)」「AI利活用ガイドライン(2019年)」「AI原則実践のためのガバナンスガイドライン(2022年)」という3つの既存指針を統合し、最新の知見に基づいてアップデートしたものです。策定にあたっては、広島AIプロセスの包括的政策枠組みや国際指針、行動規範の内容を全面的に反映させており、国際的なルール体系と国内の事業環境をシームレスに接続することを意図しています。ガイドラインは、AIに関わる主体を「開発者」「提供者」「利用者」の3つのレイヤーに明確に分類し、各主体が共通して取り組むべき基本理念や指針を定めており、「人間中心のAI社会」の実現を究極の目標に掲げています。

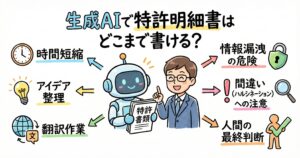

知的財産の保護に関しても、本ガイドラインは極めて明確な姿勢と要件を示しています。データの前処理やモデルの学習段階、さらにはAIシステムの開発・実装からサービス提供後の運用フェーズに至るまで、第三者の著作権や営業秘密、特許権をはじめとする知的財産権を不当に侵害しないための適切なデータ品質管理とセーフガードの導入が、すべての事業者に強く求められています。

日本の著作権法第30条の4は、世界的に見ても機械学習のためのデータ利用に対して寛容な「情報解析特例」を設けていると国際的に評されることがありますが、これは決して無制限のデータスクレイピングや利用を許諾しているわけではありません。権利者の利益を不当に害する場合や、情報解析の目的と鑑賞・享受目的が混在していると判断される場合には、著作権侵害の責任を問われる重大なリスクが存在します。そのため事業者は、法令の趣旨と適用限界を正確に理解し、法務・知財部門と連携した社内コンプライアンス体制を徹底する必要があります。日本政府もこの点に関するガイドラインの明確化や啓発活動を強化しており、企業がグローバルな競争力を持つAI技術の開発を進める上で、適法なデータ収集と知的財産保護の両立は、AIガバナンスにおける最も重要な柱の一つとして明確に位置づけられています。

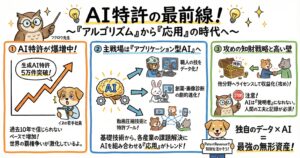

生成AI時代における知財の収益化戦略と持続的成長

世界各国で生成AIに関するルール形成やコンプライアンス要件の厳格化が進む中、企業は単に規制に対応する「守り」の姿勢にとどまるべきではありません。真に求められているのは、AI技術が生み出す新たな無形資産を事業価値や利益に転換する「攻め」の知財収益化(IP Monetization)戦略の構築です。ベンチャーキャピタルの動向を見ても、2024年におけるスタートアップ投資全体の3分の1以上がAI関連企業に集中しており、株式市場においてもAI関連企業は非AIのソフトウェア企業と比較して最大4倍もの高いバリュエーション・プレミアムを獲得しています。この事実は、世界の投資家が旧来の物理的な設備資産や人的資本よりも、特許、アルゴリズム、独自のデータセットといった「AI駆動型の無形資産」に対して圧倒的な期待と価値を見出していることの明確な証左です。

これからの高度な企業経営において、生成AIモデルや最適化されたデータ群は、単なる技術的な差別化要因ではなく、不動産や金融商品と同様に厳格なガバナンスのもとで管理され、明確な投資対効果(ROI)が測定されるべき「資産クラス(Asset Class)」として認識されなければなりません。知財の収益化を効果的に進めるための戦略の第一歩は、自社が保有する特許やデータといった知財ポートフォリオの全容を正確に分析し、その市場における潜在的な価値を客観的に評価することです。ビジネスの長期的な目標と知財戦略を緊密に連動させ、市場の需要を的確に見極めた上で、ライセンス供与、事業売却、あるいは自社製品への独占的な組み込みといった多様な収益化モデルの中から、最適なアプローチを選択することが最高財務責任者(CFO)や事業開発部門に求められます。

とくに生成AIの時代において劇的なパラダイムシフトが起きているのが、企業が保有する「データ」の潜在的な価値の解放です。マッキンゼーの最新の調査によれば、世界中の経営幹部の86%が自社内に十分に商業化されていない「未活用の資産」が存在すると回答しており、その筆頭としてデータ資産が挙げられています。従来、多くの企業は膨大なデータをデータレイクに蓄積しながらも、それを分析して過去の傾向を把握するにとどまり、直接的な収益化には苦心していました。しかし、生成AIの推論能力と自律的な意思決定機能を活用することで、データから得た洞察を直接ビジネスのワークフローに組み込み、自動的にアクションを起こす「スケールする知能(Intelligence at scale)」の構築が可能となりました。企業は生成AIというエンジンを用いることで、社内に眠るデータを新たなサービスやサブスクリプション型の収益源へと劇的に変換することができるのです。

同時に、テクノロジー企業における2025年以降の最新の知財戦略のベストプラクティスとしては、AI自体を活用したデータ主導の意思決定プロセスの導入が挙げられます。先進的な企業や法律事務所は、自律的に機能するAI駆動型の特許分析プラットフォームや知財管理システムを積極的に導入し、知財業務のデジタルトランスフォーメーションを推進しています。

| AI駆動型・知財戦略における最新の定量的な成果とメリット | 具体的な効果の規模 |

| 知財権侵害リスクの劇的な低減 | 先行技術調査を研究開発のサイクルに直接組み込むことで、製品ローンチ時の侵害リスクを最大65%低減 |

| 製品投入サイクルの高速化 | 開発と知財確認のプロセスを統合することで、新製品の市場投入スピードを平均30%加速 |

| ライセンス収益の最大化 | 無作為な大量出願から、事業目標に合致したターゲット出願への移行により、ライセンス収益が40%向上 |

| 競合分析とランドスケープ調査の効率化 | AIツールを用いた特許データの解析により、競合他社の技術動向やトレンド分析にかかる時間を75%削減 |

さらに、現代の知財戦略において「オープンイノベーション」の観点も忘れてはなりません。自社で特許や技術を完全に独占して外部を排除するクローズドなアプローチだけでなく、戦略的なライセンス供与や共同研究を通じて社内の知見を社外のパートナー企業と循環させ、業界全体のエコシステムを拡大・標準化(デファクトスタンダード化)していくことも、収益化戦略の極めて重要な一手です。ただし、ここで注意すべきは、知財を共有する最終的な目的はあくまで自社のビジネス基盤の強化と長期的な利益の確保にあります。単なる無償提供に終わらせず、適正な対価を獲得し、法的リスクや技術流出を的確に排除しながらパートナー選定や契約交渉を進めるためには、専門家による高度なデューデリジェンスと法務サポートが必須となります。

まとめますと、G7広島サミットが提起した「生成AIの機会とリスクの管理」という課題は、EUにおける罰則を伴う厳格なAI法の施行、米国におけるNISTを中心とした実践的なリスク管理フレームワークの普及、そして日本におけるアジャイルな事業者ガイドラインの策定という形で、各国の多様なルールへと急速に実装されつつあります。企業はこれらの複雑に絡み合う国際的なコンプライアンス要件を的確に遵守する強固なガバナンス体制を敷くことが大前提となります。その上で、AIモデルやデータという強力な無形資産を経営陣のリーダーシップのもとで戦略的に管理し、「知財の収益化」へと果敢に挑戦していくイノベーションの推進が求められています。法的遵守という堅牢な盾と、知財戦略という鋭利な矛の両輪をバランスよく回すことこそが、激動の生成AI時代を生き抜き、持続的な成長を実現するテクノロジー企業の絶対条件と言えるでしょう。

(この記事はAIを用いて作成しています。)

参考文献リスト

1 外務省: 広島AIプロセスに関するG7首脳声明 https://www.mofa.go.jp/mofaj/ecm/ec/page5_000483.html 2 内閣府: 広島AIプロセス包括的政策枠組 https://www8.cao.go.jp/cstp/ai/ai_senryaku/6kai/11shunouseimei.pdf 3 欧州議会: EU AI Act Regulation (EU) 2024/1689 https://artificialintelligenceact.eu/wp-content/uploads/2024/04/TA-9-2024-0138_EN.pdf 4 欧州議会: EU AI Act first regulation on artificial intelligence https://www.europarl.europa.eu/topics/en/article/20230601STO93804/eu-ai-act-first-regulation-on-artificial-intelligence 5 米国国立標準技術研究所: AI Congressional Mandates and Executive Orders https://www.nist.gov/artificial-intelligence/ai-congressional-mandates-executive-orders-and-actions 6 米国財務省: Financial Services AI Risk Management Framework https://home.treasury.gov/news/press-releases/sb0401 7 RSM US: Executive Order on AI Governance https://rsmus.com/insights/services/risk-fraud-cybersecurity/executive-order-highlights-importance-of-ai-governance.html 8 Hyperproof: Navigating NIST AI Risk Management Framework https://hyperproof.io/navigating-the-nist-ai-risk-management-framework/ 9 米国国立標準技術研究所: AI Risk Management Framework https://www.nist.gov/itl/ai-risk-management-framework 10 Baker McKenzie: Importance of NIST AI Risk Management Framework https://insightplus.bakermckenzie.com/bm/investigations-compliance-ethics/united-states-the-growing-importance-of-the-nist-ai-risk-management-framework 11 Ocean Tomo: AI as IP – A Framework for Boards Executives and Investors https://oceantomo.com/insights/ai-as-ip-a-framework-for-boards-executives-and-investors/ 12 Lumenci: Effective IP Monetization Strategies https://lumenci.com/blogs/effective-ip-monetization-strategies/ 13 PatSnap: IP Strategies Technology Companies 2025 Guide https://www.patsnap.com/resources/blog/articles/ip-strategies-technology-companies-2025-guide/ 14 Modern Counsel: Innovative IP Monetization Strategies https://modern-counsel.com/2025/innovative-ip-monetization-strategies-for-global-expansion/ 15 McKinsey & Company: Intelligence at scale – Data monetization in the age of Gen AI https://www.mckinsey.com/capabilities/business-building/our-insights/intelligence-at-scale-data-monetization-in-the-age-of-gen-ai 16 外務省: 高度なAIシステムを開発する組織向けの広島プロセス国際指針 https://www.mofa.go.jp/files/100573472.pdf 17 総務省・経済産業省: AI事業者ガイドライン(第1.0版)概要 https://www.taira-m.jp/AI%E4%BA%8B%E6%A5%AD%E8%80%85%E3%82%AC%E3%82%A4%E3%83%89%E3%83%A9%E3%82%A4%E3%83%B3%EF%BC%88%E7%AC%AC1.0%E7%89%88%EF%BC%89%E6%A6%82%E8%A6%81.pdf 18 経済産業省: AIに関連する主な諸原則等 https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20240419_2.pdf 19 Clifford Chance: Copyright compliance under the EU AI Act for GPAI model providers https://www.cliffordchance.com/insights/resources/blogs/ip-insights/2025/10/copyright-compliance-under-the-eu-ai-act-for-gpai-model-providers.html 20 AI Act Explorer: Code of Practice Overview https://artificialintelligenceact.eu/code-of-practice-overview/ 21 欧州委員会: GPAI code of practice transparency https://digital-strategy.ec.europa.eu/en/policies/contents-code-gpai 22 AI Act Explorer: Article 53 https://artificialintelligenceact.eu/article/53/ 23 Cambridge Forum on AI Law and Governance: Enhancements and Next Steps for the G7 Hiroshima AI Process https://www.cambridge.org/core/journals/cambridge-forum-on-ai-law-and-governance/article/enhancements-and-next-steps-for-the-g7-hiroshima-ai-process-toward-a-common-framework-to-advance-human-rights-democracy-and-rule-of-law/767476A314F4D697C10489CDBCC09C39 24 米国国立標準技術研究所: NIST Risk Management Framework Aims to Improve Trustworthiness https://www.nist.gov/news-events/news/2023/01/nist-risk-management-framework-aims-improve-trustworthiness-artificial 25 CSIS: Shaping Global AI Governance https://www.csis.org/analysis/shaping-global-ai-governance-enhancements-and-next-steps-g7-hiroshima-ai-process 26 総務省: 高度なAIシステムに関係する全ての関係者向けの広島プロセス国際指針 https://www.soumu.go.jp/hiroshimaaiprocess/pdf/document03.pdf 27 HiPro: AIやデジタル時代の知的財産戦略 https://biz.hipro-job.jp/column/corporation/intellectual-property-strategy/