1. 著作権法第30条の4の基本構造と生成AI学習の適法性

日本における生成AIと著作権の関係性を正しく理解するためには、まず著作権法第30条の4という極めて重要な規定の趣旨を紐解く必要があります。この条文は、技術革新を阻害しないための柔軟な権利制限規定として機能しており、日本のAI開発競争力を根底から支える法的な基盤となっています。

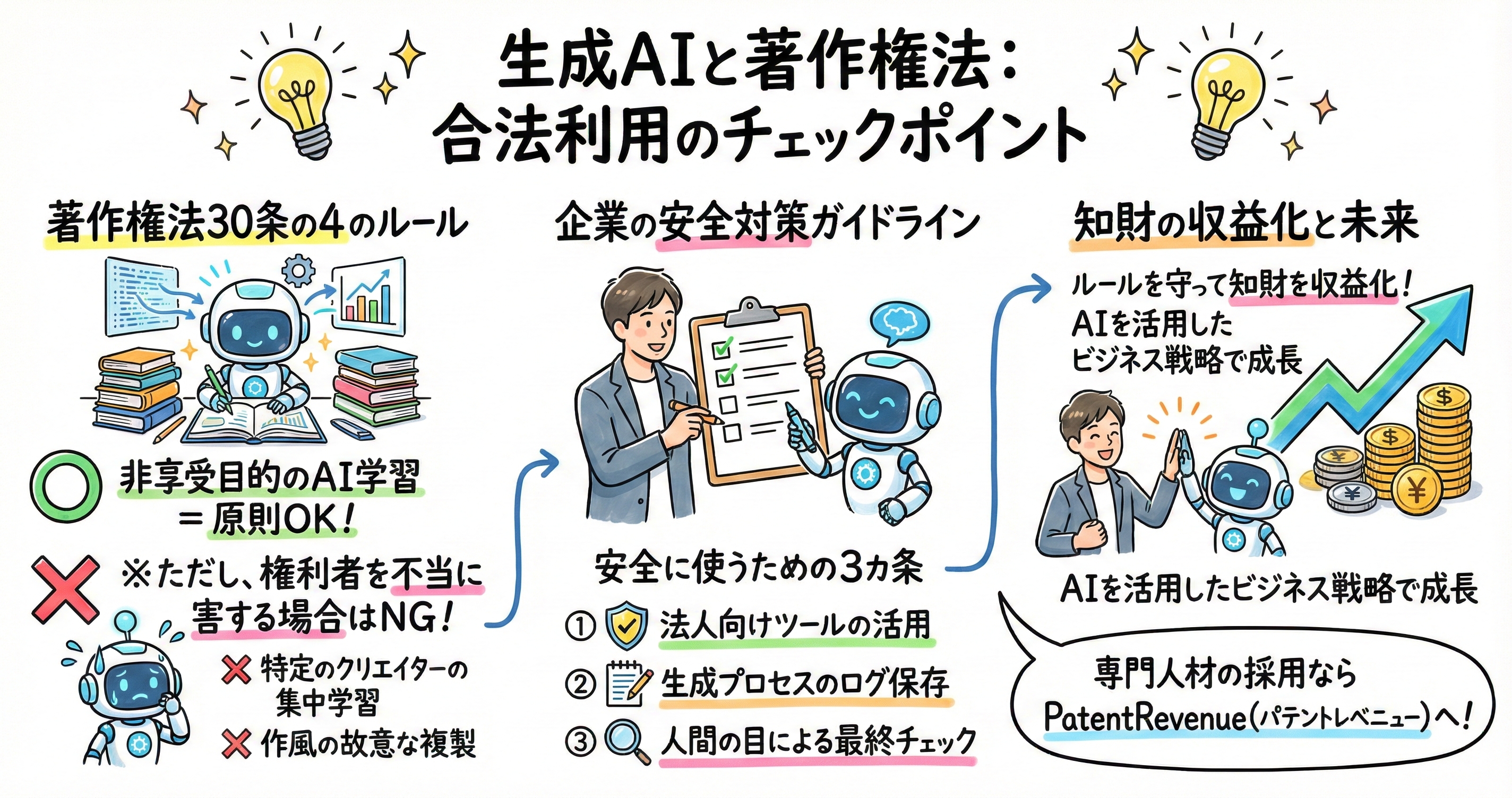

著作権法第30条の4は、「著作物に表現された思想又は感情の享受を目的としない利用」について、原則として権利者の許諾を得ることなく著作物を利用できると定めています。例えば、人間が小説を読んで感動したり、絵画を見て美しさを味わったりする行為は、作品の表現を直接的に味わう「享受」にあたります。一方で、AIが大量のテキストデータや画像データをインターネット上から収集し、そこから言語の統計的な出現確率や色・線のパターンの特徴を抽出して学習モデルを構築する行為は、著作物の表現そのものを人間が味わうことを目的としていないため「非享受目的」とみなされます。この規定により、日本ではインターネット上に公開されている膨大な著作物をスクレイピング等の技術を用いて収集し、AIの学習データとして利用することが、原則として適法に行える環境が整っています。

しかしながら、この規定は無条件のフリーパスではありません。第30条の4の但し書きには、「当該著作権者の利益を不当に害することとなる場合は、この限りでない」という極めて重要な例外規定が存在します。情報解析という大義名分があったとしても、権利者の市場を直接的に奪うような形態での学習や利用は、著作権侵害を構成する可能性が残されているのです。現在、生成AIを巡る法的な議論の多くは、この「不当に害する場合」の具体的な境界線をどこに引くかという一点に集約されつつあります。

2. 「不当に害する場合」の境界線と文化庁の最新の著作権見解

「著作権者の利益を不当に害する場合」という抽象的な文言について、文化庁の文化審議会著作権分科会は「AIと著作権に関する考え方」という報告書を取りまとめ、実務上の明確な指針を示しました。この報告書の素案に対しては約2万5,000件ものパブリックコメントが寄せられ、クリエイター側からの強い懸念と、AI開発事業者側からの過度な規制に対する反発が交錯し、社会的な関心の高さが浮き彫りとなりました。

報告書において示された解釈の方向性によれば、現行法下であっても特定の行為は著作権侵害、すなわち不当な権利侵害にあたる可能性が高いとされています。その代表的な例が、「特定のクリエイター作品の集中的な学習」です。汎用的な知識を獲得するために多様なデータを広く浅く学習するのではなく、意図的に特定のイラストレーターや作家の作品のみを大量に収集し、そのクリエイターの表現スタイルを模倣することに特化したAIモデルを構築する行為は、権利者が本来得るべきライセンス収入の機会を奪い、市場において直接的に競合するため、第30条の4の但し書きに抵触する可能性が強く指摘されています。

さらに、「特定の作品や作風の故意な複製」も同様に問題視されています。生成AIを用いて、意図的に既存の特定の作品やクリエイターの作風を再現しようとプロンプトを調整し、出力する行為は、著作権侵害を構成する蓋然性が極めて高いと考えられています。文化庁はこうした事態に対処するため、AIによって著作権侵害を受けたクリエイター向けの相談窓口を開設し、必要に応じて弁護士が無料で対応する体制を整備するとともに、クリエイターや開発事業者が対策を議論する「AIと著作権に関する関係者ネットワーク」を設置し、継続的なルール形成と実態把握に努めています。

3. 海外の著作権裁判例から学ぶ生成AIの開発リスクと市場への影響

日本国内での議論が進む一方で、生成AIの法的リスクを包括的に評価する上では、グローバルな法廷闘争の動向を注視することが不可欠です。特に、AI開発の主要拠点である米国では、AIの学習段階における著作物利用の適法性を巡って、Stability AI、The New York Times 対 OpenAI、Concord Music Group 対 Anthropicなど、画像、テキスト、音楽といったあらゆる分野の著作物に関して大規模な訴訟が相次いで提起されています。

米国の著作権法において、学習データとしての無断利用が適法か否かは「フェア・ユース(公正利用)」の法理に基づいて判断されます。最近の関連判決では、AIの学習段階における著作物利用について、実務に多大な影響を与える重要な判断基準が示されました。具体的には、フェア・ユースの判断において「中間的利用」という一時的な形態だけを見るのではなく、AI開発プロジェクト全体としての「利用目的」を総合的に評価すること、AIモデル内における著作物の保持形態そのものが直ちに著作権侵害を否定する根拠にはならないこと、そして何よりも「AI学習用データが潜在的市場に与える影響」を極めて重視するという点が強調されています。

裁判所は、利用されたデータの量や実質性そのものよりも、それが最終的に「公衆にアクセス可能となり、オリジナルの著作物と競合する代替物となりうるか」という点を厳格に精査する傾向にあります。この米国の「潜在的市場への影響(代替可能性)」を重視するアプローチは、日本の著作権法第30条の4における「著作権者の利益を不当に害する場合」の解釈とも根本的な部分で共通の理念を持っています。日本企業がグローバルに生成AIサービスを展開する、あるいは海外のAIモデルを利用する際には、日本の法律だけでなく、こうした各国の司法判断が形成する国際的なコンセンサスを常に把握しておくことが強く求められます。

4. 企業における生成AI利用ガイドラインの策定と著作権コンプライアンスの徹底

こうした複雑な法環境の中で、企業が日常業務に生成AIを安全に導入し、著作権侵害のリスクを未然に回避するためには、社内における厳格なガイドラインの策定とコンプライアンスの徹底が不可欠となります。法務担当者が不在、あるいはリソースが不足している組織であっても、日本ディープラーニング協会(JDLA)などが無償で公開している利用ガイドラインの雛形を活用し、組織の目的に合わせた独自のルールと運用体制を構築することが推奨されています。

ガイドラインに含めるべき主要なチェックポイントの第一は、「著作権侵害の判断基準の理解と入力の制限」です。生成物が著作権侵害と判断されるには、「既存の著作物に似ているか(類似性)」と「既存の著作物を参考にしたか(依拠性)」の2点が要件となります。企業が意図せず既存のデザインや文章に似たものを生成し、そのまま商用利用してしまうリスクを防ぐため、プロンプトに特定の著作権者名、作品名、既存の文章をそのまま入力することを明確に禁止するルールを設ける必要があります。

第二のチェックポイントは、社内における「利用目的と適用範囲の明確化」および「機密情報の取り扱いルールの徹底」です。ガイドラインの策定手順としては、まず自社の現状の課題とリスクを洗い出し、組織の目的に合わせた方針を決定した上で、具体的なルールと運用体制を構築します。さらに、策定したルールを単に掲示するだけでなく、社員の生成AIリテラシー格差を踏まえ、著作権が問題となる使い方や最新の事故事例を共有する研修を定期的に実施し、全社的に周知徹底を行うことが実効性を担保する上で重要となります。

5. 著作権侵害を回避するための法人向けツール選定と生成プロセス管理

ガイドラインによるルールの徹底に加えて、システム面での安全対策として「権利関係に対応済みの法人向けツールの選定」が極めて重要です。無料版の生成AIツールは、ユーザーが入力したプロンプトやデータをAIモデルの再学習に利用する設定がデフォルトとなっていることが多く、機密情報の漏洩や、自社の独自のノウハウが他者への回答として出力されてしまうリスクを常に孕んでいます。

そのため、企業がビジネスで安心してAIを活用するには、個人向けの無料ツールを避け、入力データが学習されないことを規約で明確に保証している法人向けツールを導入すべきです。さらに、著作権侵害のリスクを抜本的に削減するためには、Adobe Fireflyのように著作権をクリアしたクリーンなデータのみを学習しているツールや、GoogleのGeminiのように、万が一法的トラブルが発生した際にベンダー側が著作権保護の補償を行う規約が含まれているサービスを選択することが推奨されます。商用利用を前提とした法的補償のあるツールを選ぶことは、企業防衛の最前線となります。

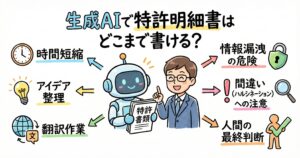

また、「生成プロセスの保存・管理と最終チェック体制の確立」も不可欠な実務プロセスです。万が一、外部から著作権侵害の疑いをかけられた場合に備え、どのようなプロンプトを入力し、どのような修正の過程を経てその生成物が作られたかという生成ログを保存しておくことは、「意図的な盗用ではない(依拠性がない)」ことを客観的に証明する強力な証拠となります。そして、生成物を最終的に外部へ公開する前には、AIの出力を過信せず、イラストであれば逆画像検索ツール、文章であればコピペチェックツールなどの専用ツールを活用しつつ、必ず人間の目による最終確認を行う工程を組み込むことが、企業としての責任を果たす上で極めて重要です。

6. 画像生成AIがもたらす新たな著作権・商標権トラブルと企業に求められる倫理的配慮

生成AIの中でも、特に法的な摩擦や社会的な議論を激しく引き起こしているのが画像生成AIの分野です。2025年以降、画像生成AIは飛躍的な進化を遂げ、実写と見紛うほどのクオリティや、複雑なイラストレーションを瞬時に生成することが可能となりましたが、それに伴い著作権や倫理面でのトラブルが次々と顕在化しています。

具体的なトラブルの代表例として、生成された画像内に実在する企業のブランドロゴや有名なキャラクターが無断で再現されてしまうケースが散見されます。これは単なる著作権侵害にとどまらず、商標権(トレードマーク権)の侵害にあたる可能性が高く、企業側は自社のブランド価値を保護するために、ネット上の生成コンテンツに対する監視システムを強化し、利用規約の改訂や法的措置に踏み切る事態へと発展しています。

また、特定の著名なアーティストやイラストレーターの「画風」を精巧に真似た画像が生成され、それが商用市場に大量に出回ることで、著作権者やファンから強い抗議が相次ぐ事例も多発しています。著作権法上、画風やアイデアそのものは原則として保護の対象外とされていますが、市場において特定のクリエイターの仕事がAIによって完全に代替され、経済的な不利益を被る状況は、社会的な許容度を大きく超えているとの批判が強まっています。

こうした事例は、単なる法解釈の問題にとどまらず、企業が商用利用する際の倫理的課題としての側面を明確に浮き彫りにしています。AIを利用したことによって「人間のモデルやクリエイターの仕事を奪っている」といった批判を招く表現になっていないか、あるいは「顧客やクリエイターへの配慮が欠如している」としてSNS等で炎上するリスクを十分に考慮しているかなど、法令遵守の枠を一段超えた企業倫理の観点での高度なリスクマネジメントが強く求められるようになっています。

7. 知財の収益化に向けた最新の生成AI戦略とリーガルテック市場の台頭

法的なリスク管理と倫理的配慮を徹底することを前提とした上で、生成AIを戦略的に活用することは、企業の「知財の収益化」において計り知れないビジネスのポテンシャルを秘めています。2026年現在、生成AIは一部の専門家だけのものではなく、誰もが手軽に活用できるインフラとなり、個人でも企業でもAIを活用して直接的に稼ぐことが現実的な事業戦略の柱となっています。

特に顕著な成長を見せているのが、リーガルテックや知財特化型のソリューション分野です。これらの分野では、生成AIを活用して知財のマネタイズ支援へと事業を拡大するスタートアップが累計3.8億円といった巨額の資金調達を実現する事例も報告されています。特許関連の高度なデータ分析サービス市場は、2033年までに約41億ドル規模に達すると予測されており、生成AIの技術がこの巨大市場の成長を強力に牽引する重要な要素となっています。個人レベルでも、生成AIを活用してデジタルコンテンツ市場で月数万円単位の継続的な収益を達成するクリエイターが現れるなど、収益化の裾野は急速に広がっています。

企業が知財収益化・マネタイズを成功させるための戦略的なポイントは、汎用的なAIツールをそのまま使うのではなく、特定の業界やニッチな課題に深く特化することにあります。金融分野や法務分野のように、専門用語や業界特有のルールに対応した独自の大規模言語モデル(LLM)を開発・提供することで、強力な差別化要因となり、高単価でのビジネス展開が可能になります。

また、AIは決して完璧な存在ではないため、事実確認や法的正確性が厳格に求められる分野においては、人間による最終チェック(Human-in-the-Loop)を業務プロセスに組み込むことが必須です。これにより顧客の確固たる信頼を獲得し、長期的なビジネス関係の構築へとつなげることができます。AIの導入は生産性を劇的に高める一方で、技術を戦略的に活用し知財を収益化できる層と、そうでない層との間に大きな格差を生む可能性があるため、常に最新技術をキャッチアップし、実践を通じた継続的な学習を行うことが競争優位性を保つための鍵となります。

8. 生成AI時代における著作権保護とビジネスの持続可能な調和に向けて

生成AIの技術は、人類の創造性や業務効率を飛躍的に拡張する強力なツールであると同時に、既存の著作権制度やクリエイターの権利保護のあり方に根本的な問いを投げかけています。日本の著作権法第30条の4は、世界に先駆けてAI学習の柔軟な枠組みを提供し、イノベーションを後押ししてきましたが、その実際の運用においては「著作権者の利益を不当に害する場合」という極めて繊細な境界線を巡り、社会全体のコンセンサスを形成していく途上にあります。

企業が生成AIを安全にビジネスの現場へ組み込み、自社の知財の収益化という新たな価値を継続的に創出するためには、法律の条文をただ形式的に追うだけでは不十分です。最新の文化庁のガイドラインの更新や、絶え間なく続く海外の著作権裁判例の動向に常にアンテナを張り、自社のAI利用ルールをアジャイルにアップデートし続ける柔軟性が求められます。そして、入力データの厳格な管理、法的補償を備えた法人向けツールの選定、生成プロセスの透明性ある記録、そして最後は必ず人間の責任による確認といった多層的な防御策を組織全体で講じることが不可欠です。

技術革新による多大な恩恵を最大限に享受しつつも、文化の発展に寄与してきた人間のクリエイターの権利と尊厳を正当に保護すること。この二つの価値の最適なバランスを取りながら、倫理的かつ持続可能なビジネスのエコシステムを構築していくことが、今後のAI開発と利用に携わるすべての企業に課せられた最大の使命と言えるでしょう。

(この記事はAIを用いて作成しています。)

参考文献リスト

- 【事例あり】生成 AI 社内ガイドライン策定ガイド https://googleworkspace.tscloud.co.jp/gemini/gen-ai-copyright-infringement-cases

- 生成AIがもたらす収益化の新時代 https://note.com/kenny_ai/n/n53505fc386c2

- 文化庁 令和6年度 著作権分科会 AI 著作権 報告書 https://yorozuipsc.com/blog/69ai

- 生成AI 利用ガイドライン 企業 雛形 https://bizroad-svc.com/blog/seiseiai-guidline/

- 米国著作権法におけるフェア・ユースの判断基準 https://www.nagashima.com/publications/publication20250227-1/

- 画像生成AIを巡る著作権問題の現状 https://gigxit.co.jp/blog/blog-20273/